การโกหกเป็นสิ่งที่เกิดขึ้นในชีวิตประจำวันของมนุษย์อย่างหลีกเลี่ยงไม่ได้ นักวิทยาศาสตร์ประเมินว่าเราโกหกเฉลี่ยวันละประมาณสองครั้ง แม้ว่าจะยากที่จะกำหนดตัวเลขนี้อย่างแม่นยำ แต่สิ่งที่ชัดเจนคือมนุษย์ไม่เก่งในการจับโกหกเลย และนี่คือจุดเริ่มต้นของการศึกษาที่น่าสนใจเกี่ยวกับการใช้ AI ในการตรวจจับความจริงและความเท็จในคำพูดของคน

ทำไมการจับโกหกถึงสำคัญ?

การรู้ว่าคนอื่นโกหกหรือพูดความจริงมีความสำคัญในหลายบริบท ตัวอย่างแรกที่ชัดเจนคือในงานสืบสวนสอบสวนของตำรวจ เมื่อตำรวจสัมภาษณ์ผู้ต้องสงสัย ข้อมูลที่ได้รับจะนำไปสู่ขั้นตอนต่อไปของการสืบสวน ดังนั้นการรู้ว่าผู้ต้องสงสัยพูดจริงหรือโกหกจึงมีผลโดยตรงต่อความสำเร็จของคดี

นอกจากนี้ เรื่องนี้ยังเกี่ยวข้องกับชีวิตประจำวันของทุกคนด้วย เช่น ความสงสัยว่าคู่รักของเราจะนอกใจหรือไม่ ซึ่งเป็นเรื่องที่หลายคนอยากรู้ แต่ปัญหาคือมนุษย์เองก็ไม่เก่งในการจับโกหกเท่าไหร่

มนุษย์จับโกหกได้แค่ไหน? คำตอบอาจทำให้ผิดหวัง

งานวิจัยหลายชิ้นยืนยันว่ามนุษย์เมื่อถูกถามให้ตัดสินว่าใครโกหกหรือไม่ โดยไม่รู้ข้อมูลบริบทหรือเกี่ยวกับคนนั้นมากนัก ผลการตัดสินของเรามักจะไม่ต่างจากการโยนเหรียญเลย คือประมาณ 50% เท่านั้น

แม้แต่ผู้เชี่ยวชาญ เช่น ตำรวจ นักกฎหมาย หรือแม้แต่นักจิตวิทยา ก็ไม่ได้มีความแม่นยำมากกว่าคนทั่วไปเท่าไหร่ จากการวิเคราะห์ผลการทดลอง 108 งานวิจัยในปี 2006 พบว่าคนธรรมดามีความแม่นยำประมาณ 54% ในขณะที่ผู้เชี่ยวชาญได้แค่ 55% เท่านั้น ซึ่งถือว่าไม่ดีเลยสำหรับการตัดสินความจริงจังหรือไม่ในคำพูดของผู้อื่น

AI กับการจับโกหก: ความเป็นไปได้และข้อจำกัด

แล้วถ้าเรามี AI ที่ช่วยจับโกหกล่ะ? คำตอบคือในปัจจุบันยังไม่มี AI ที่สมบูรณ์แบบสำหรับงานนี้ แต่มีงานวิจัยที่น่าสนใจโดยทีมงานของ Riccardo Loconte ซึ่งได้ใช้เทคนิคที่เรียกว่า “fine tuning” เพื่อเทรน AI ให้จับโกหกได้ในบางบริบท

“Large language models” หรือโมเดลภาษาใหญ่ คือระบบ AI ที่ถูกออกแบบมาเพื่อสร้างข้อความที่เหมือนมนุษย์พูดคุยกัน แต่อย่างไรก็ตาม การทำให้ AI เหล่านี้มีความเชี่ยวชาญในงานเฉพาะ เช่น การจับโกหก ต้องใช้การเทรนเพิ่มเติมที่เจาะจงกว่าการเรียนรู้ทั่วไปเหมือนนักเรียนที่เรียนจบปริญญาตรีแล้วต้องไปเรียนต่อเฉพาะทาง

การเทรน AI ด้วยชุดข้อมูล (Datasets)

การเทรน AI จำเป็นต้องใช้ชุดข้อมูลที่มีทั้งข้อความจริงและข้อความที่โกหก เพื่อให้ AI เรียนรู้ความแตกต่าง อย่างในงานวิจัยนี้ใช้ชุดข้อมูลสามชุดหลัก ได้แก่ ข้อความเกี่ยวกับความคิดเห็นส่วนตัว, ความทรงจำในอดีต และเจตนาในอนาคต

ตัวอย่างเช่น ในชุดข้อมูลเกี่ยวกับความทรงจำในอดีต ผู้เข้าร่วมจะถูกขอให้เล่าประสบการณ์วันหยุดที่ผ่านมาอย่างจริงใจ หรือในเงื่อนไขโกหกจะถูกขอให้แต่งเรื่องขึ้นมาและพยายามโน้มน้าวให้คนอื่นเชื่อว่ามันเป็นเรื่องจริง เช่น บอกว่าตนเคยไปเที่ยวเวียดนาม ทั้งที่จริงๆ ไม่เคยไป

ขั้นตอนการทดสอบ AI

หลังจากเทรน AI ด้วยชุดข้อมูลเหล่านี้แล้ว จะมีการทดสอบ AI ด้วยชุดข้อมูลที่ AI ไม่เคยเห็นมาก่อน เพื่อดูว่า AI สามารถแยกแยะความจริงและโกหกได้ดีแค่ไหน เหมือนการสอบปลายภาคของนักเรียนที่ต้องทำข้อสอบใหม่โดยไม่เคยเห็นข้อสอบนี้มาก่อน

ในงานวิจัยนี้ใช้โมเดลที่ชื่อว่า FLAN-T5 (หรือเรียกเล่นๆ ว่า “Flanny”) ซึ่งเป็นโมเดลภาษาใหญ่ที่พัฒนาโดย Google

ผลการทดลองที่น่าสนใจ

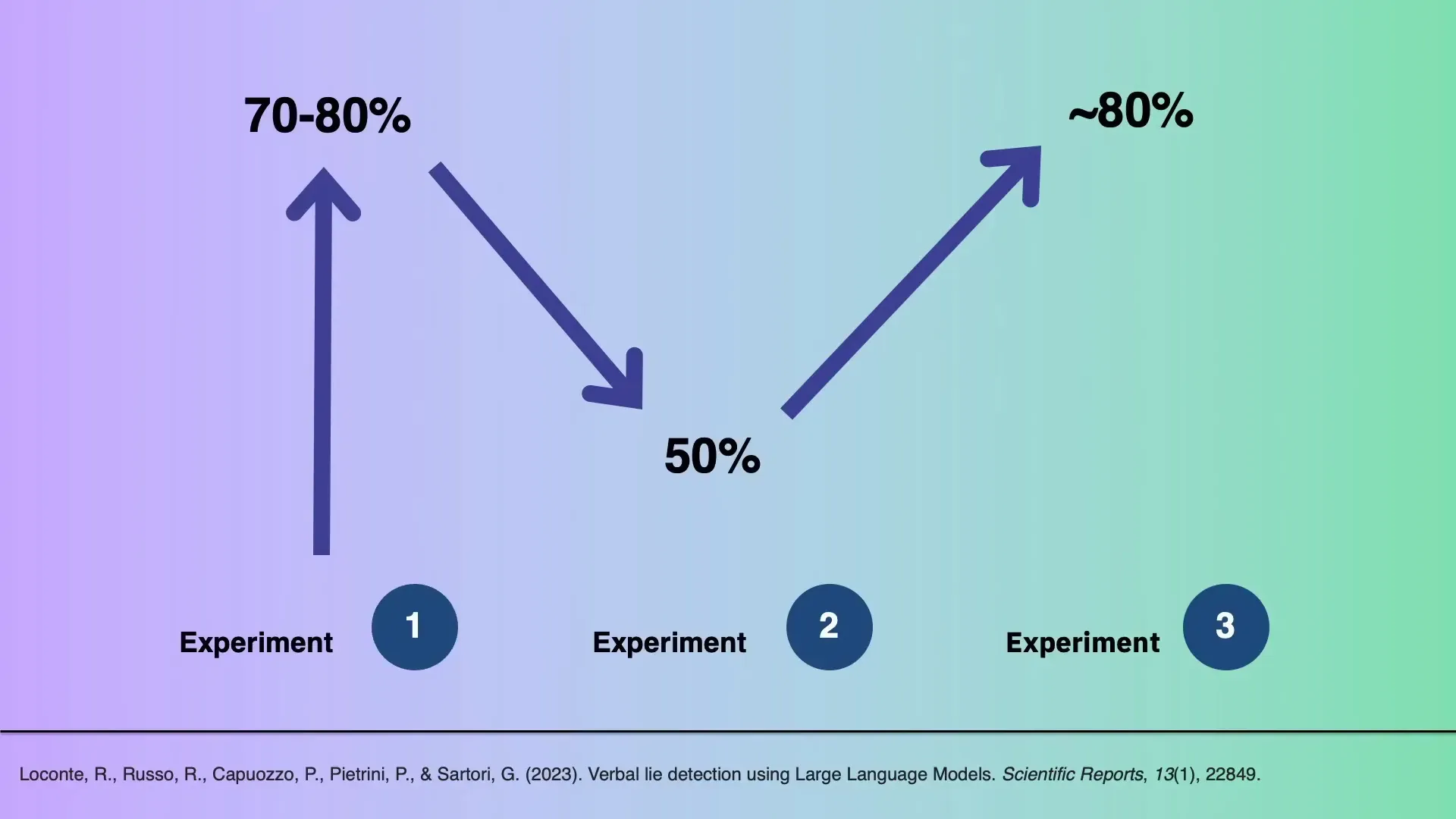

งานวิจัยแบ่งเป็น 3 การทดลองหลัก:

- เทรน AI กับชุดข้อมูลแต่ละชุดแยกกัน

- เทรน AI กับสองชุดข้อมูลพร้อมกัน แล้วทดสอบกับชุดที่เหลืออีกชุด

- เทรน AI กับชุดข้อมูลทั้งหมดรวมกัน

ผลลัพธ์พบว่า ในการทดลองแรกและสาม โมเดล FLAN-T5 สามารถจับโกหกได้แม่นยำถึง 70-80% ซึ่งดีกว่ามนุษย์อย่างชัดเจน

แต่ในการทดลองที่สอง โมเดลทำได้แค่ประมาณ 50% เท่านั้น ซึ่งเท่ากับการเดาแบบสุ่ม นี่แสดงให้เห็นว่า AI ยังมีปัญหาในการนำความรู้ที่เรียนจากบริบทหนึ่งไปใช้กับอีกบริบทหนึ่ง เพราะการโกหกนั้นมีลักษณะขึ้นอยู่กับบริบทและสถานการณ์ที่แตกต่างกัน

โอกาสและความท้าทายในอนาคต

ผลการทดลองชี้ให้เห็นว่า AI สามารถช่วยตรวจจับโกหกได้ดีในบริบทที่ได้รับการเทรนมาดีพอ แต่ยังต้องการการพัฒนาและทดสอบเพิ่มเติมก่อนจะนำไปใช้จริงในชีวิตประจำวัน

ลองจินตนาการถึงโลกที่เทคโนโลยีตรวจจับโกหกด้วย AI ถูกนำมาใช้ในหลายด้าน เช่น

- ความมั่นคงของชาติ ที่สามารถตรวจสอบความตั้งใจของผู้คนก่อนข้ามพรมแดนหรือขึ้นเครื่องบิน

- การเมือง ที่ช่วยให้สามารถแยกแยะว่าผู้พูดจริงใจหรือแค่พูดเพื่อผลประโยชน์

- การสรรหาบุคลากร ที่ช่วยให้บริษัทเลือกคนที่มีความตั้งใจจริง ไม่ใช่แค่พูดเก่งเพื่อได้งาน

- โซเชียลมีเดีย ที่ช่วยป้องกันการหลอกลวงและข่าวปลอม

อย่างไรก็ตาม เทคโนโลยีนี้ยังมีความเสี่ยง หากผู้คนเชื่อ AI อย่างไม่ตั้งคำถาม อาจทำให้เกิดการกล่าวหากันโดยไม่มีมูล และทำลายความไว้วางใจในสังคม เพราะการพึ่งพา AI มากเกินไปอาจทำให้มนุษย์ละเลยการคิดวิเคราะห์และตัดสินใจด้วยตนเอง

ความสำคัญของความโปร่งใสและการตีความผล AI

สิ่งที่ผู้วิจัยเน้นคือ AI ควรไม่ใช่แค่บอกว่าใครโกหกหรือไม่ แต่ควรอธิบายเหตุผลและหลักฐานที่ทำให้ AI ตัดสินใจเช่นนั้น เหมือนกับรีวิวร้านอาหารที่ไม่ใช่แค่ให้ดาว แต่ยังมีรีวิวบอกว่าจุดเด่นและจุดด้อยของร้านคืออะไร เพื่อให้ผู้ใช้สามารถตัดสินใจด้วยตัวเองได้

โลกอนาคตที่น่าจะเป็นคือโลกที่ AI เป็นเครื่องมือเสริมสร้างความเข้าใจและช่วยให้มนุษย์ตัดสินใจได้ดีขึ้น ไม่ใช่เป็นผู้ตัดสินแทนมนุษย์อย่างสิ้นเชิง

ศัพท์เทคนิคที่ควรรู้

- Large Language Models (โมเดลภาษาใหญ่): ระบบ AI ที่ถูกเทรนด้วยข้อมูลจำนวนมหาศาลเพื่อสร้างข้อความในรูปแบบที่เหมือนมนุษย์พูด

- Fine Tuning (การเทรนเฉพาะทาง): การฝึก AI เพิ่มเติมเพื่อทำงานเฉพาะด้าน โดยใช้ชุดข้อมูลที่เฉพาะเจาะจง

- Dataset (ชุดข้อมูล): ข้อมูลที่ใช้ในการเทรน AI โดยประกอบด้วยตัวอย่างข้อมูลจริงและข้อมูลปลอม (โกหก) เพื่อสอน AI ให้รู้จักแยกแยะ

บทสรุปจาก Insiderly

การใช้ AI ในการตรวจจับความจริงและความเท็จเป็นการก้าวหน้าทางเทคโนโลยีที่น่าตื่นเต้นและมีศักยภาพสูง ผลการวิจัยชี้ให้เห็นว่า AI สามารถทำงานนี้ได้ดีกว่ามนุษย์ในบางบริบท แต่ยังมีข้อจำกัดในเรื่องการปรับใช้ข้ามบริบทที่แตกต่างกัน

ความท้าทายที่สำคัญคือการรักษาสมดุลระหว่างการใช้ AI เพื่อช่วยในการตัดสินใจและการรักษาความสามารถในการคิดวิเคราะห์ของมนุษย์ ไม่ควรปล่อยให้ AI กลายเป็นผู้ตัดสินแทนทั้งหมด เพราะนั่นอาจนำไปสู่ความเสี่ยงของการสูญเสียความไว้วางใจและการพึ่งพาเทคโนโลยีอย่างไม่ลึกซึ้ง

ดังนั้นอนาคตของ AI ในการตรวจจับโกหกจึงไม่ใช่แค่เรื่องของเทคโนโลยี แต่เป็นเรื่องของการพัฒนาเครื่องมือที่ช่วยเสริมสร้างความเข้าใจและความเชื่อมั่นระหว่างมนุษย์ด้วยกันเองและกับเทคโนโลยี

การพัฒนา AI ที่โปร่งใส อธิบายเหตุผลได้ และยังคงส่งเสริมให้ผู้ใช้คิดวิเคราะห์เองได้ จะเป็นกุญแจสำคัญที่จะทำให้เทคโนโลยีนี้เป็นประโยชน์จริงในสังคม